Google发布TPU人工智能服务器芯片技术_电子元器件供应商_IC代理商

Google今天在一篇论文中公布了Tensor人工智能服务器处理芯片TPU的详细资料。TPU是一种专门为本地高效率处理人工智能计算任务设计的服务器芯片,Google公司从2015年就开始使用这种芯片,虽然2016年Google曾经曝光该芯片的存在,但是并未提供任何技术方面的细节信息。

在今天的全国工程师学术会议上,TPU论文的75位联合作者之一,David Patterson就TPU的技术论文发表了演讲。

Patterson指出,Google依赖TPU来完成人工智能神经网络第二阶段的计算任务。首先,在第一阶段Google用大量数据训练神经网络,这个阶段的计算任务主要依靠服务器GPU来加速,然后,Google使用TPU来更有效率地推断新数据,Google宣称GPU在新数据推断方面的性能表现大大优于GPU或者x86处理器芯片。

“虽然一些应用的处理器使用率并不高,但是TPU的处理速度依然能够比当下的GPU或CPU快上15-30倍”,Google在论文中写道。Google所指的“当下的GPUS和CPU”,分别是Nvidia的TeslaK80和英特尔Haswell 架构Xeon E5-2699 v3这样的“当红炸子鸡”。

过去五年,AMD和Nvidia两大显卡厂商凭借人工智能热潮重新回到IT产业聚光灯下,而显卡GPU也成了深度学习的默认低成本基础设施技术,这其中Google也起到不小的推动作用。但是Google、微软等IT巨头从未放弃其他人工智能芯片技术领域的探索,这其中包括用来处理多种AI工作任务的FPGA芯片技术。而TPU则是Google的原创技术,已经应用于Google图像搜索、GoogleCloud Vision API等生产环境。

TPU处理器芯片的内存是K80这样的GPU芯片的3.5倍,而体积却更小,每瓦特功耗的处理性能则是GPU的30-80倍。

相比大多数IT互联网企业,Google是人工智能神经网络的先行者和践行者,早在2013年Google就宣称为了满足不断膨胀的人工智能计算需求,Google需要将当时的数据中心服务器计算力提高一倍,而如果基于通用芯片实现这一点,成本会高得难以承受,因此Google开始研发性能价格比10倍于GPU的人工智能专用芯片。

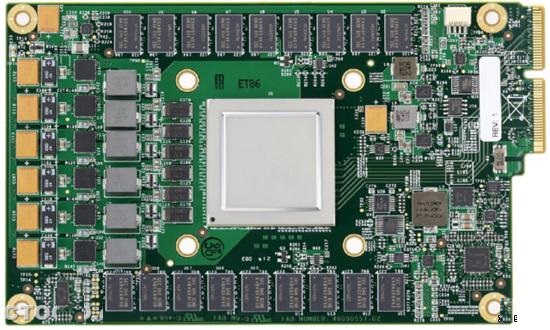

为了提高TPU的部署效率,Google的TPU没有选择于CPU集成,而是以协处理器的方式直接插入PCIe总线,可以像GPU一样在现有的服务器上“即插即用”。从设计架构的角度来看,TPU更接近FPU(浮点运算协处理器)而不是GPU。